Cognitive Computing tritt als neue Technologie auf den Plan und verspricht uns schlauer und effektiver zu machen. Google Now, Apple Siri oder Microsoft Cortana sind bereits beim Konsumenten angekommen. Neu ist, dass Unternehmen selber mit den Schnittstellen, die z. B. IBM Watson, Google und Microsoft Azure ML anbieten, nach den Sternen greifen können. Schlaue Assistenten versprechen u. a. bessere Antworten auf unsere Fragen zu haben – manchmal sogar auf welche, die wir uns noch gar nicht gestellt haben.

Der Mensch erweitert seine Möglichkeiten mit einem neuen Werkzeug. Die Fähigkeit des Menschen, abstrakte Werkzeuge herstellen zu können, wurde lange als Alleinstellungsmerkmal angesehen. Inzwischen ist sie bei einer Vielzahl anderer Lebewesen nachgewiesen worden. Kognitiv unterstützende Werkzeuge haben eine neue, alltägliche und selbstverständliche Qualität, die unter Philosophen unter dem Begriff Extended Mind beleuchtet wird, d. h. inwiefern diese ein unbewusster Teil von uns werden. Diese Werkzeuge sind in der Lage, unser Menschenbild zu verändern und werfen Fragen auf:

Wer ist in dem System Mensch-Maschine für eine Fehlfunktion verantwortlich? Damit meine ich nicht nur den sprichwörtlichen, plötzlichen GAU sondern auch kleinste Tendenzen, die große Wirkungen haben können.

Sind wir Menschen darauf vorbereitet? Was bedeutet das für den Einsatz dieser Technologien durch Unternehmen und Institutionen?

2018 werden laut IDC die Hälfte aller Konsumenten regelmäßig mit Services in Kontakt sein, die auf Systemen mit wahrgenommenen kognitiven Fähigkeiten basieren. Den Weg dorthin werden Firmen wie z. B. IBM bereiten, indem sie Unternehmen programmierbare Schnittstellen zu Cognitive Computing, Machine-Learning und Natural-Language-Processing zur Verfügung stellen, die bisher in spezialisierten Anwendungen gekapselt waren.

Kunden müssen wieder glauben können

Traumwandlerisch wandern schon heute Finger über das digitale Kleinod in meiner Hand und dieses weiß mir allerhand zu empfehlen. Lokalisierte Aufgabenerinnerungen (Todoist), welche coolen Lokale in der Nähe sind und was ich kaufen sollte – andere haben das ja auch schon getan. Ich bekomme Inhalte zum Lesen empfohlen, da ich durch mein bisheriges Verhalten bestimmte Interessen gezeigt habe. Im Shop, in der Google-Suche, in der Social-Media-Timeline und bei den schlauen Erinnerungen von Google Now, überall wird geholfen, zu meinem Besten. Als Nutzer werde ich entlastet, kann mich anderen Dingen widmen (welchen eigentlich?).

Um als Benutzer selbstverständlich mit diesen kognitiv angereicherten Services “verschmelzen” zu können, muss ich an sie und ihre Zuverlässigkeit glauben. Fehler werden so zu Fehlern des Gesamtsystems Mensch-Maschine. Der (Denk-)Fehler des Menschen besteht darin, dass er an ein System glaubt, das er nicht begreifen, nicht er-greifen kann wie einen Hammer. Diese Maschinen sind weniger externe Erweiterungen als viel mehr internalisierte. Es sind mit Rechenzentren verdrahtete Gehirne, gewissermaßen.

Fehlertoleranz #1

Wenn mir Amazon mal wieder ein Buch empfiehlt, das ich in einer anderen Ausgabe längst besitze, lässt mich das lächeln. Wenn ich allerdings mit gleichen Suchbegriffen unterschiedliche Ergebnisse angezeigt bekomme als mein Nachbar, oder in der Facebook-Timeline manche Kontakte seltener sichtbar sind als andere, dann ist für mich Schluss mit Lächeln. Das involvierte System hält mich in einer sog. Filter-Bubble, mit besten Absichten der Programmierer allerdings.

Wenn ich als Benutzer von diesen Eingriffen des Systems weiß, kann ich mich bewusst dafür entscheiden, mir den intendierten Nutzen zu eigen zu machen, oder ich schalte bewusst den angebotenen Autopiloten aus, wenn das geht (indem ich z. B. eine andere Suchmaschine verwende).

Neue Kompetenzen für Benutzer

Es geht um Transparenz für den Nutzer und dadurch auch um Medienkompetenz. Heute konfigurieren viele Kinder die Smartphones ihrer Eltern und Lehrer müssen extra auf Schulungen geschickt werden, um überhaupt zu begreifen, in was für einer Welt sich ihrer Schüler bewegen. Erst dann können sie bewusst die Lerninhalte um Kompetenzen für die neuen Medien erweitern.

Das wird eine zunehmend wichtigere Aufgabe werden.

Neue Chancen für Unternehmen

Sie werden in die Lage versetzt, mehr aus den ihnen vorliegenden Daten zu schöpfen. Natürlich gilt weiterhin Garbage-in-Garbage-out, d. h. die Datenqualität ist wesentlich für den Erfolg.

In welcher Form auch immer den Kunden neuer Nutzen geboten werden soll – z. B. passendere Empfehlungen oder Antworten, vorausschauender Service – es sollte transparent geschehen. Erst dann können sich Kunden mit einem guten Gefühl, d. h. vertrauensvoll diesen Services hingeben und ggf. Fehler tolerieren oder sogar selber mithelfen, in dem sie eigenständig Daten aktuell und relevant halten. Weil sie wissen, was sie davon haben.

Das Vertrauen der Kunden ist die Währung der Zukunft.

Fehlertoleranz #2

Wenn von Menschen und Technik die Rede ist, lohnt sich ein Blick auf die Sozialpsychologie: Zunehmend, aber noch ausbaufähig, wird der Kunde von Unternehmen als Individuum verstanden. Zugespitzt ist es die Anerkenntnis des Kunden als autonomes Wesen:

“Konformität hat einen schlechten Ruf, Autonomie einen sehr guten: Niemand wird sich gern sagen lassen, dass er ein Mitläufer ist, und in hochindividualisierten Gesellschaften gelten Eigenständigkeit, Durchsetzungs- und Urteilsfähigkeit ebenso wie die daraus abgeleiteten Entscheidungen und Handlungen als hohes Gut. […] Die Sozialpsychologie etwa kann − von den Konformitätsexperimenten aus den dreißiger Jahren bis zu den neueren Forschungen der Verhaltensökonomik − immer wieder feststellen, dass auch moderne Menschen im Zweifel die Mehrheitsauffassungen der eigenen, autonomen, vorziehen.” (aus Merkur 9/10 2011, Harald Welzer, Sebastian Wessels)

Hui! Die Wissenschaftler zeigen auf, dass Menschen, die nach wissenschaftlichen Standards als Nonkonformisten identifiziert worden sind, trotzdem in konkreten Situationen zu konformistischen Handeln neigen – und umgekehrt! Deren Handlungen sind weniger vorhersagbar als angenommen.

Als öffentliche Person tendiert der Mensch zu konformen Verhalten. Der Verkaufspsychologie sind diverse Mechanismen bekannt, die funktionieren und angewandt werden. Aber: Zeigen die o. g. Erkenntnisse eine sozialpsychologische Grenze der Big-Data-Analyse, des Profilings des einzelnen Kunden auf, der Vorhersagbarkeit seiner zukünftigen Handlungen?

Auch Unternehmen stellt sich die Frage nach Transparenz und Vertrauen, wenn sie kognitiven Computersystemen mehr Macht geben. Diese arbeiten ja nicht von Menschen vorgegebene Algorithmen Schritt-für-Schritt ab. Wer überwacht deren Funktionsfähigkeit, wer kann noch bewerten, ob sie noch das Richtige tun – für die Kunden und das Unternehmen?

Derartige Systeme können auch in das Unternehmen hinein wirken: Mein Blogger-Kollege Sven Körber erzählte mir von einer Firma, die wirklich nachgefragte Kompetenzen von Mitarbeitern ermittelt, indem sie das Social Intranet automatisch analysieren lässt. Der Schritt zur automatischen Kündigung ist dann nicht weit.

The Medium is the Message.

Social-Media-Netzwerke sind nur auf der Oberfläche sozial. Die technische Grundlage ist agnostisch gegenüber Menschlichem. Die Menschen werden zu Bytes, die von Algorithmen verarbeitet werden. Bedienen wir uns dieser Mittel, werden wir letztlich zu dem was das System aus uns macht. Der User ist das Produkt. Ein Datum. Teil dieses Menschen-zu-Daten-machenden-Systems sind die Programmierer und deren Vorgesetzte, funktionierende Rädchen der Organsisation.

Kognitive Systeme wiederum stellen an der Oberfläche kognitive Möglichkeiten zur Verfügung. Wir können mit ihnen in den Dialog treten, uns oder unsere Daten ihnen anvertrauen. Auch hier gilt: als Mensch ist man Datenlieferant für das System, letztlich nicht unterscheidbar von Sensoren einer Maschine innerhalb des Internet-of-Things.

Signale, Verknüpfungen, Analysen, Entscheidungen.

Den Unterschied machen die Intentionen der Menschen, die diese Maschinen ermächtigen. Der Glaube an den Fortschritt der Technik und das Wissen um die Tendenzen des Mediums müssen sich nicht ausschließen.

Sonst wird der Mensch zum Fehler im System.

Ich freue mich über Kommentare zu diesem Artikel. Zusätzlich können Sie uns demnächst auf zwei Veranstaltungen antreffen und direkt mit mir und meinen Kollegen diskutieren:

brightONE auf der BITKOM KnowTech 2015

brightONE Consulting im Programm der KnowTech 2015:

- Rechnest Du noch oder denkst Du schon? Ein Lackmustest für Cognitive Computing (Tag 1, Forum 4 “Cognitive Computing, Stefan Holtel & Kai Nörtemann, brightONE Consulting)

- Literarisches Quartett: Müssen wir neu denken im Zeitalter von Cognitive Computing? (Tag 2, Interaktives Format, Stefan Holtel, brightONE Consulting; Markus Mathar, optional Dr. Maren Risch, medien+bildung.com, Willi Schroll, strategic labs)

brightONE auf Next Economy Open NEO#15:

Die Next Economy Open führt am 9. und 10. November 2015 in Bonn Unternehmen und Netzszene zusammen und diskutiert in offenen Formaten lösungsorientiert über Herausforderungen und Chancen der vernetzten Wirtschaft.

Stefan Holtel von brightONE Consulting wird am zweiten Tag mit dem Soziopod-Blogger Patrick Breitenbach auf der #NEO15 Bühne disputieren: “Der VW-Skandal und die Folgen: Wenn Menschen und Maschinen lügen #NEO15 Session” und am zweiten Tag die Frage “Machen uns digitale Assistenten klüger? Spagat zwischen natürlicher Dummheit und künstlicher Intelligenz” bearbeiten.

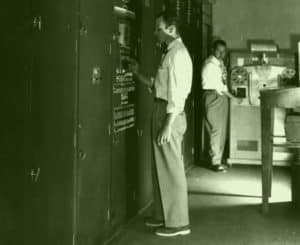

Titelbild: Electronic Discrete Variable Automatic Computer, PublicDomain (modifiziert)

Leave a Reply